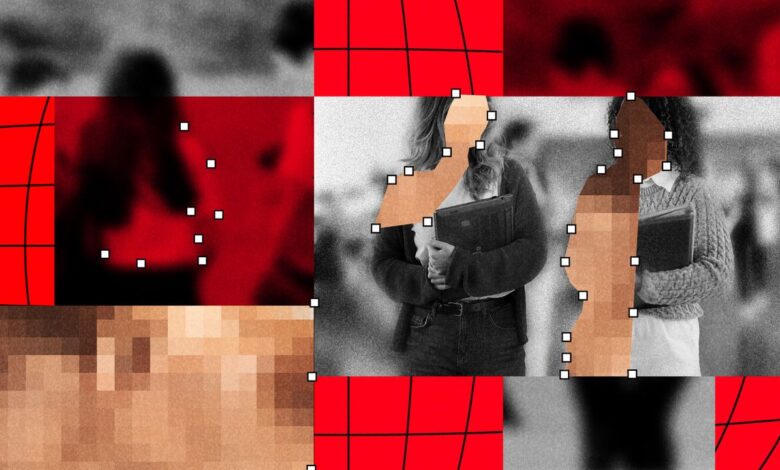

La crisis de deepfakes en las escuelas es mucho peor de lo que pensábamos

Suele empezar con una foto descargada de las redes sociales. En todo el mundo, los adolescentes guardan imágenes de Instagram y Snapchat de chicas que conocen de la escuela y utilizan aplicaciones dañinas de «nudificación» para crear fotos o videos falsos de ellas desnudas. Estos deepfakes pueden compartirse rápidamente en escuelas enteras, dejando a las víctimas humilladas, desesperadas y con miedo a que las imágenes les persigan para siempre.

La crisis de los deepfakes en las escuelas empezó lentamente hace un par de años, pero desde entonces ha crecido considerablemente a medida que la tecnología utilizada para crear imágenes explícitas se ha hecho más accesible. Los incidentes de abusos sexuales por deepfake han afectado a unos 90 escuelas de todo el mundo y han afectado a más de 600 alumnos, según una revisión de incidentes denunciados públicamente realizada por WIRED e Indicator, una publicación centrada en el engaño digital y la desinformación.

Cuáles son los casos de deepfakes en cada país

Los hallazgos muestran que desde 2023, los estudiantes, a menudo varones en las preparatorias, en al menos 28 países han sido acusados de usar IA generativa para apuntar a sus compañeros de clase con deepfakes sexualizados. Las imágenes explícitas, en las que aparecen menores, se consideran material de abuso sexual infantil (CSAM). Se cree que este análisis es el primero en revisar casos reales de abuso de deepfakes de IA que tienen lugar en escuelas de todo el mundo.

En conjunto, el análisis muestra el alcance mundial de la dañina tecnología de nudificación por IA, que puede hacer ganar a sus creadores millones de dólares al año, y demuestra que, en muchos incidentes, las escuelas y las fuerzas del orden no suelen estar preparadas para responder a los graves incidentes de abuso sexual.

En toda Norteamérica, se han denunciado casi 30 casos de abuso sexual deepfake desde 2023, incluido uno con más de 60 presuntas víctimas, uno en el que la víctima fue expulsada temporalmente de la escuela y otros en los que los alumnos de varias escuelas presuntamente han sido atacados simultáneamente. Se han denunciado más de 10 casos en Sudamérica, más de 20 en Europa y otra docena en Australia y Asia Oriental.

WIRED e Indicator han colaborado en la recopilación de datos y el análisis de este gráfico. El mapa incluye los casos de deepfakes en cada región del mundo. Fuente: WIRED; Indicator

Es probable que la verdadera magnitud del abuso sexual mediante deepfakes en las escuelas sea mucho mayor. Una encuesta realizada por UNICEF, la agencia de las Naciones Unidas para la infancia, estima que el año pasado se crearon deepfakes sexuales de 1.2 millones de niños y niñas. Uno de cada cinco jóvenes en España declaró a investigadores de Save the Children que se habían creado deepfakes de ellos desnudos. La organización de protección infantil Thorn descubrió que uno de cada ocho adolescentes conoce a alguien que ha sido víctima de desnudos falsos, y en 2024, el 15% de los estudiantes encuestados por el Centro para la Democracia y la Tecnología afirmó tener conocimiento de deepfakes generados por IA vinculados a su escuela.

«Creo que sería difícil encontrar una escuela que no se haya visto afectada por esto. Lo más importante es cómo somos capaces de ayudar a las víctimas cuando esto ocurre, porque sus efectos pueden ser masivos», menciona Lloyd Richardson, director de tecnología del Centro Canadiense de Protección Infantil.

El análisis de WIRED e Indicator se fijó en los incidentes de los que se ha informado públicamente con detalles específicos, como la ubicación de las escuelas y el recuento de víctimas potenciales. En la mayoría de los casos se trata de informes en lengua inglesa, y en muchos países no se dispone de datos al respecto. Muchos incidentes nunca se publican en la prensa o, si se publican, puede que no incluyan detalles específicos, y en su lugar pueden ser tratados de forma privada por las escuelas y los funcionarios encargados de hacer cumplir la ley.

Difícil de detectar, pero con patrones claros

En casi todos los casos, los presuntos responsables de la creación de las imágenes o videos son varones adolescentes. A menudo se comparten en aplicaciones de redes sociales o a través de mensajería instantánea con compañeros de clase. Y son enormemente perjudiciales para las víctimas. «Me preocupa que cada vez que me vean, vean esas fotos», declaró una víctima de Iowa a principios de este año. «Ha estado llorando. Casi no come», dijo la familia de otra.

En múltiples casos, las víctimas a menudo no quieren asistir a la escuela o enfrentarse a ver a quienes crearon imágenes o clips explícitos de ellas. «Se siente desesperanzada porque sabe que es probable que esas imágenes lleguen a internet y lleguen a manos de pedófilos», afirma el abogado Shane Vogt, y tres estudiantes de la Facultad de Derecho de Yale, Catharine Strong, Tony Sjodin y Suzanne Castillo, que representan a una adolescente anónima de Nueva Jersey en una acción legal contra un servicio de nudismo. «Está gravemente angustiada por saber que esas imágenes están ahí fuera, y tendrá que vigilar internet el resto de su vida para evitar que se difundan».

DERECHOS DE AUTOR

Esta información pertenece a su autor original y fue recopilada del sitio https://es.wired.com/articulos/la-crisis-de-deepfakes-en-las-escuelas-es-mucho-peor-de-lo-que-pensabamos